Si elle constitue une opportunité pour les hackers, la technologie derrière ChatGPT peut également être mobilisée par les équipes de cybersécurité pour mieux surveiller les données et répondre aux attaques.

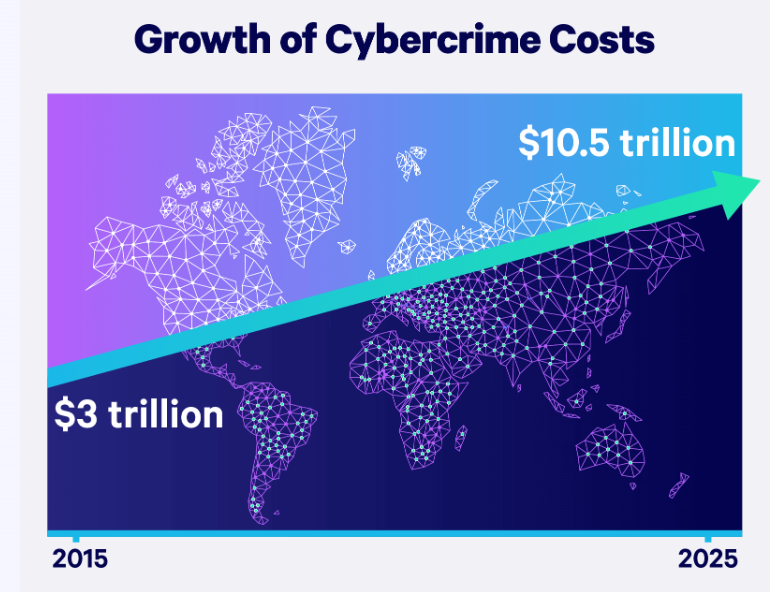

Ma petite entreprise ne connaît pas la crise, chantait Alain Bashung. Un slogan que pourraient aujourd’hui se réapproprier les hackers de tout poil. Car s’il est un secteur qui ignore les turbulences de la conjoncture économique, c’est bien le cybercrime. En hausse constante depuis plusieurs années, les cyberattaques ont vu leur rythme ’accroître encore depuis lsa guerre en Ukraine, le gouvernement russe donnant plus que jamais un blanc-seing aux cybercriminels opérant depuis son territoire.

Mais depuis quelques mois, une nouvelle menace cause également des sueurs froides aux experts de la cybersécurité. Il s’agit de la montée en puissance et de la démocratisation de l’intelligence artificielle générative, capable de créer des contenus de toute pièce et révélée au grand public via les logiciels de création d’images comme Dall-E, ainsi que par le chatbot ChatGPT.

Comment l’IA générative assiste les arnaqueurs

On l’a vu: ChatGPT est très performant pour rédiger comme un humain, et pour peu que l’on ne soit pas au courant que l’on converse avec une machine, on peut rapidement se faire avoir. C’est précisément cette caractéristique qui pourrait faciliter le travail des cybercriminels.

En effet, nombre d’entre eux n’ont pas l’anglais pour langue maternelle (61% des cyber attaques sont ainsi perpétrées par des groupes pro-Kremlin selon une récente étude de Thalès, et ces derniers sont majoritairement russophones), ce qui donne aux attaques d’hameçonnage (qui visent à abuser la confiance d’un internaute et à le faire cliquer sur un lien malveillant) un aspect quelque peu grossier, avec souvent une syntaxe et une orthographe approximatives, auxquelles peu d’internautes se laissent prendre. En aidant les cybercriminels à améliorer leur niveau de langue, ChatGPT pourrait donc leur permettre d’accroître l’efficacité de leurs actions malveillantes en trompant la vigilance de leurs victimes et faisant ainsi tomber davantage de personnes dans le panneau. Pour rappel, 95% des failles de sécurité sont dues à une erreur humaine, selon le World Economic Forum.

Une autre caractéristique de ChatGPT est «l’inférence», soit la capacité à puiser dans l’immense quantité de données sur lesquelles il a été entraîné pour comprendre le contexte de la conversation et fournir des réponses appropriées. Là encore, cette caractéristique est du pain béni pour le hacker, qui peut plus facilement faire croire à un employé d’une grande entreprise qu’il est un de ses collègues, en maîtrisant le jargon utilisé dans cette société, faisant référence à des dossiers en cours ou à d’autres personnes travaillant pour l’entreprise.

«Ce que l’on appelle “l’ingénierie sociale” prend une tout autre mesure avec l’IA générative. Il devient très facile de se faire passer pour quelqu’un d’autre et de contourner les astuces traditionnelles employées pour détecter les fraudes», résume Anneka Gupta, cheffe de produit chez Rubrik, spécialiste de la gestion des données.

Le piratage ubérisé

Mais la cybercriminalité ne se résume naturellement pas à l’espionnage, les hackers recourent également à des logiciels malveillants pour infecter leur cible et prendre leurs données en otage pour demander une rançon, ou simplement causer le plus de dommage possible dans une logique purement destructrice.

Or, jusqu’à présent, coder et diffuser un logiciel espion requérait de solides compétences en informatique. Mais comme de nombreux individus expérimentant avec ChatGPT l’ont montré, celui-ci est très performant pour rédiger des lignes de code. Dans un futur proche, il n’est pas impossible que des hackers n’ayant que des compétences sommaires en informatique recourent à l’IA générative pour créer de toute pièce un logiciel malveillant sans avoir à rédiger la moindre ligne de programme informatique.

En plus d’abaisser la barrière à l’entrée du piratage, l’IA générative risque également d’augmenter les capacités de hackers les plus compétents, en leur permettant d’accroître leur productivité et donc leur capacité de nuisance. «Les programmes comme ChatGPT sont très performants pour créer des logiciels. C’est rarement parfait, mais il ne faut en général qu’une petite quantité de travail pour partir du code qu’ils ont rédigé et en faire un programme qui fonctionne. C’est beaucoup moins pénible que de tout coder soi-même depuis le début. Ils permettent donc aux développeurs expérimentés de programmer beaucoup plus rapidement. On peut ainsi s’attendre à une hausse de la fréquence et de l’efficacité des cyber attaques», affirme Zachary Chase Lipton, chercheur de l’université Carnegie Mellon spécialisé dans l’intelligence artificielle.

Là où croît le péril croît aussi ce qui sauve

Mais cette technologie peut également être mobilisée par les entreprises pour mieux lutter contre la cybercriminalité. Les algorithmes d’intelligence artificielle générative peuvent ainsi être incorporés aux solutions cloud existantes pour permettre aux clients de mieux repérer et désarmer les cyberattaques. Lors de la conférence RSA, consacrée à la cybersécurité, Google Cloud a par exemple annoncé une nouvelle solution baptisée Cloud Security AI Workbench, qui utilise de grands modèles linguistiques pour repérer les vulnérabilités et logiciels malveillants.

De même qu’elle peut rendre les hackers plus efficaces, l’IA générative peut également être mise au service des équipes de cybersécurité. «L’un des gros défis auxquels font face les équipes de cyberdéfense est le manque de talents disponibles et le temps qu’il faut pour les former. Si grâce à l’intelligence artificielle générative on peut accroître la productivité d’un spécialiste en cybersécurité de 50 à 70%, c’est un progrès énorme pour notre capacité à répondre à une attaque», note Anneka Gupta.

Le géant américain Cisco a ainsi récemment annoncé le lancement d’un AI Policy Assistant pour aider les équipes de cybersécurité à mettre en place de nouvelles stratégies de défense et à évaluer leur impact sur l’infrastructure. L’entreprise américaine de cybersécurité Crowdstrike a de son côté lancé Charlotte AI, un agent virtuel s’appuyant sur l’IA générative pour épauler les équipes de cybersécurité.

Mieux protéger ses données

De nombreuses solutions se déploient également pour permettre aux entreprises d’exploiter l’IA générative tout en protégeant efficacement leurs données contre les hackers. Lors de sa conférence annuelle À Las Vegas, le spécialiste de la gestion des données cloud Snowflake a par exemple annoncé un partenariat avec Nvidia qui vise à permettre aux développeurs de créer des applications autour de l’IA générative directement dans le cloud de snowflake, sans avoir besoin de déplacer les données, réduisant ainsi les vulnérabilités.

D’autres, comme la société Qlik, un fournisseur de solutions d’analyse de données via l’IA, permettent de traquer les données en temps réel tout au long de leur parcours, et ainsi de repérer toute intrusion malveillante. «L’un de nos clients américains utilise notre technologie pour scanner en temps réel toutes ses données issues de toutes les sources possibles (dans le cloud, sur site, dans les applications…) et surveiller ainsi les menaces potentielles. L’IA existe depuis déjà quelque temps, mais les récentes avancées autour des grands modèles linguistiques changent la donne, la qualité des données devient plus importante que jamais, il faut donc veiller à leur intégrité», précise Mike Capone, dirigeant de Qlik.

Bref, si les hackers ont de nouvelles cartes en main, les équipes de cybersécurité sont donc loin d’être démunies pour leur faire face!